Ik werk aan Mouseion, een bibliotheek die ik zo noem naar het onderzoeksinstituut in Alexandrië. Op de speciale website erover, waarin ik de opzet en werkwijze beschrijf, staat hij als zelflezende bibliotheek. Praktisch gezien werkt het als volgt: je stopt er bronnen in en je krijgt kennis terug over wie erin staat, wat er wordt beweerd, en waar bronnen elkaar kruisen, mét de epistemologische bewijslaag erbij. Die verwerkingslaag had tot deze week geen naam.

Door mijn experiment met de Groninger Oorlogspuzzels, waarin ik 3.150 handgeschreven verzetskaarten in één nacht machineleesbaar maakte, kreeg ik mooie vragen van Monique Brinks, historica die tien jaar onderzoek deed naar Het Scholtenhuis in Groningen. Om die vragen serieus te beantwoorden had ik ineens veel meer bronnen nodig dan alleen die kaarten. Daar besloot ik het meteen goed aan te pakken: een bibliotheek waarin alle relevante boeken, dossiers en archiefstukken niet alleen staan, maar ook leesbaar en kruisbaar zijn met de databaseinformatie die ik al had. Samen ongekend krachtig.

Voor het soort bibliotheek dat ik nodig had, ontbraken een paar elementen. In academische context zijn er groepen die soortgelijke aanpakken onderzoeken — het DANIEL-project van LITIS aan de Université de Rouen Normandie bijvoorbeeld, dat layout-analyse, handschriftherkenning en entity-extractie in één model integreert. Maar als werkend systeem voor één onderzoeker, dat meerdere bron-typen kan kruisen en bewijslagen geeft, vond ik niets dat doet wat ik nodig had. Dus bouwde ik het zelf, en daarvoor begon ik met onderzoek naar het landschap van tekstherkenning: OCR voor gedrukte tekst, en HTR voor handschriften.

De grootste, dominante speler in het archiefveld is Transkribus. Ik wilde weten hoe hun businessmodel werkte. Niet omdat ik klant wilde worden, maar omdat iedereen in de archiefwereld het erover heeft en ik wilde begrijpen waar het verdienmodel zit. Dus ik ging graven naar hun prijzen, de eigendomsstructuur, hun jaarverslagen, de ontvangen EU-subsidies, en naar Nederlandse projecten en organisaties die het gebruiken — en projecten die het bewust niet gebruiken, en waarom.

Een Oostenrijkse coöperatie, READ-COOP, ontwikkelt het. Het businessmodel draait op credits: één credit per handgeschreven pagina, en op de publieke prijslijst kost dat ongeveer 24 cent. Voor instituten zijn er kortingen via de Metagrapho API en maatwerkcontracten, maar zelfs bij 50% korting loopt het bij grote archieven snel op. Vijf miljoen pagina's met institutionele korting komt nog steeds uit op honderdduizenden euro's. Dat is serieus veel overheidsgeld.

Het Huygens Instituut en het Nationaal Archief deden die rekensom ook voor hun GLOBALISE-project. Ze wilden vijf miljoen pagina's VOC-archief uit de zeventiende en achttiende eeuw doorzoekbaar maken met automatische handschriftherkenning. Met Transkribus zou dat veel te duur worden. In plaats daarvan bouwden ze Loghi, een open-source alternatief.

Daarna dook ik in het hoe en wat van Loghi. De GitHub-issues vertelden meer dan de marketingteksten. Het generieke model voor handschriftherkenning scoort tot 96% op standaardmateriaal, maar voor specifieke historische datasets is finetuning essentieel, en zelfs ervaren IT'ers hebben uren nodig om het draaiend te krijgen. Ik checkte de code op GitHub en ontdekte dat de hele pipeline vastzit aan één chipfabrikant: NVIDIA. Zonder hun videokaarten draait er niks versneld. Op Apple Silicon (de chip in elke moderne Mac) werkt het alleen via emulatie, en dat is te traag voor serieus archiefwerk. Ana is daarin anders: Apple Vision draait native op de Neural Engine, Tesseract op de CPU, Claude Vision in de cloud. Geen van de drie heeft NVIDIA nodig. De hoofdontwikkelaar van Loghi hintte op een overstap naar transformers, weg van hun huidige architectuur. Ze weten dat hun motor veroudert.

Maar mijn echte inzichten zaten ergens anders.

Zowel Transkribus als Loghi stoppen namelijk bij hetzelfde punt. Ze lezen een scan en leveren tekst. Dat is het. Ze hebben geen begrip van wat er staat, ze isoleren geen entiteiten*, en ook geen verbanden tussen de gescande bronnen. Een doopakte uit 1696 en een scheepvaartlogboek uit 1742 krijgen dezelfde behandeling: van pixels naar letters en daar houdt het op.

Mijn pipeline gaat juist verder waar Transkribus en Loghi stoppen. Apple Vision leest de scan met 6% WER (Word Error Rate), een batch-pipeline verwerkt honderden scans tegelijk, en op mijn server draait het extractie-script dat er entiteiten en verbanden uit haalt. Dat draait robuust en ongekend snel. De orkestratie tussen die onderdelen is geen AI maar gewoon een script. Het verschil met Transkribus en Loghi zit niet in of het werkt, maar in waar het stopt: bij tekst, of juist een laag dieper, waardoor je er veel meer mee kunt.

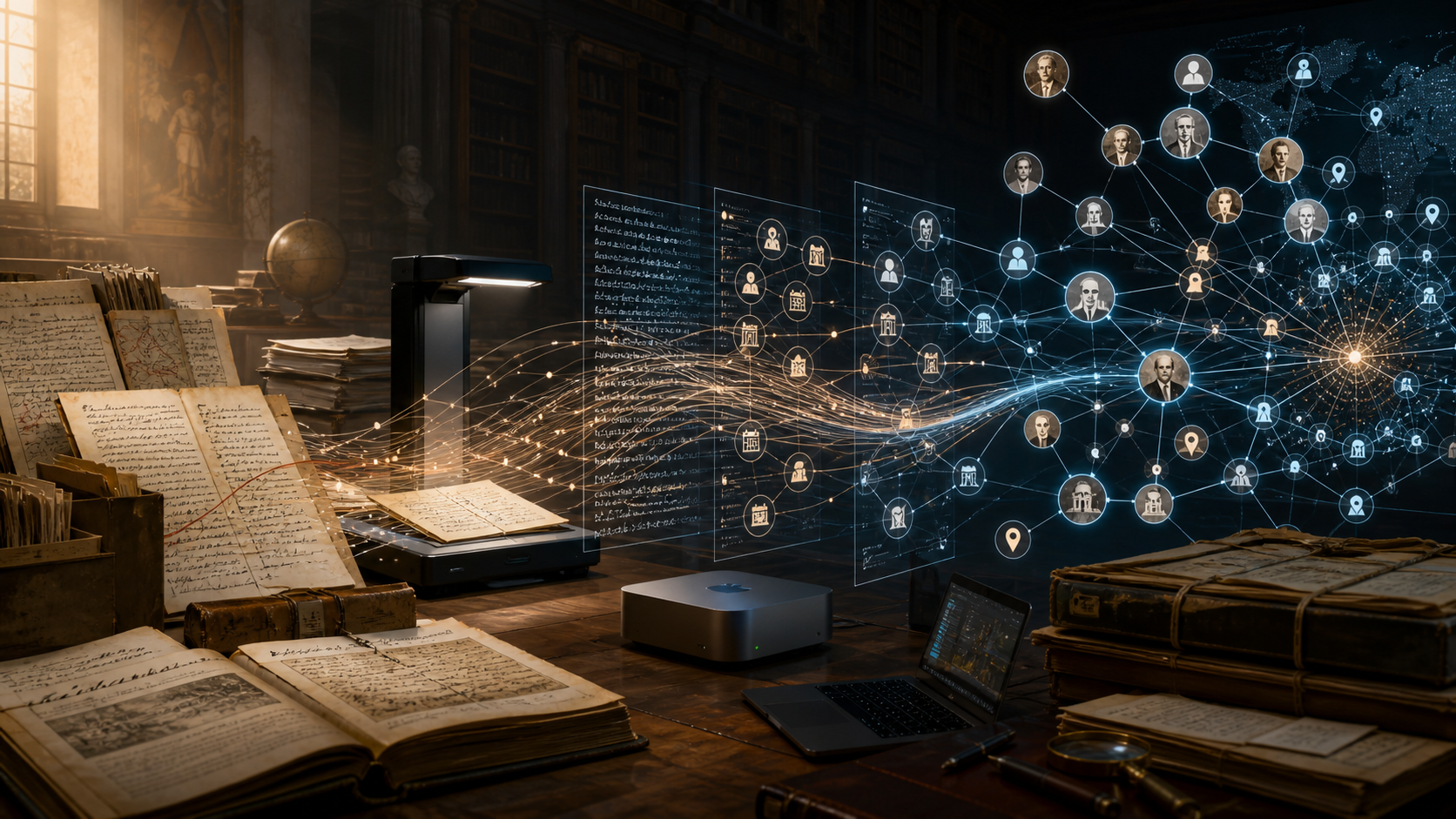

In maart las ik via mijn eigen pipeline een handgeschreven doopakte uit 1696, uit de kerk van Gits in Vlaanderen. Niet alleen de tekst. Ik herkende namen, plaatste Hubertus Carolus Vanelslander als zoon van Hubertus senior en Joanna de Kemele, kruiste de vermelding met andere aktes en traceerde een familielijn die terugging tot het einde van de zeventiende eeuw. De scan werd geen tekst. De scan werd een persoon in een netwerk, verbonden met de Groninger Oorlogspuzzels die ik elders aan het leggen was.

Dat was dus geen OCR maar lezen met begrip. Ik deed het met een combinatie van Apple Vision, Claude en mijn eigen scripts, zonder er een naam voor te hebben. Datzelfde patroon herhaalde zich op een andere plek in mijn systeem: er gingen inmiddels 52 boeken door de pipeline, ik extraheerde ruim 13.000 entiteiten, en mijn WO2-archief is uitgegroeid tot 2 miljoen records, waarvan 196.000 zijn bevestigd door twee of meer onafhankelijke bronnen. Uiterst krachtig gereedschap dus.

Nu heeft het hele lees- en extractieproces een naam: Ana.

In het Mouseion van Alexandrië was de Anagnostes (ἀναγνώστης) de voorlezer, degene die teksten toegankelijk maakte voor geleerden. De taak bestond niet alleen uit voorlezen, maar ook uit interpreteren, verbinden, en zichtbaar maken wat verborgen lag in de geschriften.

Ana doet hetzelfde, maar op een ongekende schaal en snelheid. Nogmaals, in zijn kern is dit software, geen AI in de gangbare zin. Eerder AI op een andere manier: Archivistische Intelligence.

Ana 2.0 draait inmiddels. Het werkt met vier lagen: herken de bron, lees hem met de juiste engine, begrijp de inhoud, en bewaar alles inclusief de herkomst. Het werk wordt verdeeld over de machines die ik toch al heb staan: de MacBook overdag, de Mac Mini 's nachts, en een server op het web voor wat continu moet draaien (en moeiteloos dag en nacht doorwerkt).

Het idee waar ik het meest enthousiast over ben is het bronprofiel-lexicon.

Archivarissen werken al decennia met beschrijvingsstandaarden — EAD en Records in Context bijvoorbeeld — maar die beschrijven een bron pas nadat hij is gelezen. Een archivaris leest een doos met dossiers, plaatst ze in context, en vult dan een formulier in dat achter de schermen EAD-XML wordt. Het lezen zelf gebeurt nog steeds met de hand en het hoofd. Mijn profielen sturen het lezen zelf: welke engine kunnen we het beste gebruiken bij welk type register of logboek, welke velden zijn er bij dat type te verwachten, welk vocabulaire wordt erin gebruikt, en welke valkuilen kennen we waarvan we eerder leerden.

Een doopakte zit namelijk altijd op dezelfde manier in elkaar: een datum, welke kerk, naam van het kind, vader, moeder, de getuigen, en soms ook nog een predikant. Als Ana dat weet voordat het gaat lezen, verandert alles. Het verwacht een moedernaam na de vadernaam. Het herkent dat "Hvbertvs" waarschijnlijk Hubertus is. Het signaleert als er een veld ontbreekt dat er normaal wel is. Die voorkennis maakt het lezen veel beter, en ook nog eens sneller.

Bij een nieuw type bron zoals militaire stamboeken, of notariële vastleggingen, bouw ik het profiel eerst samen met Ana op. We doorlopen eerst vijfentwintig scans, ontdekken het patroon, en leggen vast welke velden erin zitten en welke valkuilen we kunnen verwachten. Het lexicon groeit zo bij elke nieuwe bron, en wordt zelfversterkend: hoe meer profielen we hebben, hoe sneller we kunnen herkennen wat erop lijkt.

Bij gedrukte boeken hoef je dat profiel niet te bouwen. De auteur heeft het al gedaan. Een goed non-fictieboek leest zichzelf namelijk. Het heeft een index met alle belangrijke personen en begrippen, een bibliografie die het citatienetwerk al heeft uitgeschreven, voetnoten die markeren waar de bronnen liggen, en een inhoudsopgave die de structuur prijsgeeft. Shelf-Keying noem ik dat: elk boek dat je toevoegt maakt alle andere slimmer, omdat de sleutels van boek A ook op boek B worden geprobeerd.

Transkribus en Loghi leveren tekst. Ana levert tekst plus de laag erboven: entiteiten, kruisingen, herkomst. Dat is geen kwaliteitsclaim ten opzichte van hun HTR (daar zijn ze beter in dan ik ooit zal zijn), maar een verschil in scope.

We moeten even stilstaan bij wat dat betekent: een entiteit is geen woord, maar het ding waar het woord naar verwijst.

Lees ik in een doopakte uit 1696 dat "Hubertus Carolus Vanelslander, zoon van Hubertus en Joanna de Kemele, werd gedoopt in de kerk van Gits", dan haal ik daar zes entiteiten uit: drie personen, één plaats, één gebouw, één datum. Plus de relaties: vader, moeder, kind. Verschijnt diezelfde Hubertus dertig jaar later in een trouwakte, dan herkent Ana hem terug — niet omdat de letters hetzelfde zijn, maar omdat de entiteit dezelfde is (want als je weet waarom wat wat is, kun je afleiden waarom dat dat is, en dan weet je waarom wat dat is).

En dat is precies waar bewijs ontstaat: één bron die zegt dat iemand bestaat is een vermelding. Drie onafhankelijke bronnen die dezelfde persoon noemen op dezelfde datum in dezelfde plaats, dat is een feit. Zonder geïsoleerde entiteiten kun je niet kruisen, en zonder kruisen geen bewijs.

Dit element is een van de meest cruciale van mijn aanpak, en in deze vorm relatief nieuw. Het lijkt op wat in de archiefwereld Linked Data heet, met dat verschil dat hier de epistemologische bewijslagen zijn geïntegreerd — niet als latere annotatie, maar als onderdeel van de extractie zelf.

Wat dit oplevert is niet snellere OCR of een slimmere pipeline. Het is dat bronnen die los van elkaar in archiefkelders liggen (een MI5-dossier in Londen, een doopakte in Gits, een deportatielijst in Bad Arolsen) voor het eerst in dezelfde zoekvraag passen. Een naam die in drie collecties anders gespeld staat maar door Ana als mogelijke match wordt herkend, met een zekerheidslaag erbij en de vraag: is dit dezelfde persoon? Dat is geen automatisering. Dat is een soort onderzoek dat zonder dit niet bestond.

Ik liet het ontwerp doorlichten door een slim redeneerteam dat ik bouwde om blinde vlekken en biases in mijn eigen denken op te sporen. Het vond dingen die ik niet zag. Dat de feedbackloop het systeem kan corrumperen als ik consequent verkeerd corrigeer. Dat tien componenten eigenlijk vier lagen zijn. Dat het systeem aanvankelijk geen degradatiemodus had — een manier om met minder onderdelen door te draaien als er iets uitviel. Het scherpste punt waar het mee kwam: blijf hameren op de betrouwbaarheid van de keten omdat elk procent fout een gat oplevert dat zich verderop opstapelt. Eén procent op extractie, één procent op koppeling, één procent op samenvoeging — aan het eind van de keten weet je niet meer wat je weet.

Dus Ana voegt nooit automatisch entiteiten samen. Het legt de mogelijkheid voor en ik beslis. Naamvarianten zijn hypotheses die sterker worden naarmate meer bronnen ze bevestigen, niet feiten die de machine vaststelt.

Wat ik dus bouwde en robuust werkend heb: een werkend systeem, een groeiend lexicon, en een scherp beeld van het landschap. Ik weet wat Transkribus kost, waar Loghi faalt, en wat mijn eigen tools al konden voordat ik het doorhad. Inmiddels draait het profielen-lexicon ook.

Komende week pak ik volautomatisch een paar enorme collecties aan: honderdduizenden bestanden binnenhalen, in één nacht hoogwaardig laten lezen, en de eerste kruisingen blootleggen. Het oordeel over twijfelgevallen blijft mensenwerk — maar het werk om er überhaupt zicht op te krijgen, dat doet Ana.

Wat voor mij gold, geldt vermoedelijk ook voor anderen die met versplinterde bronnen werken: ergens stop je niet meer bij tekst maar wil je verder. En die richting werkt.

* Met "entiteiten" bedoel ik in dit stuk de specifieke dingen die ik uit teksten en databases isoleer en aan elkaar koppel. In mijn werk zijn dat onder andere: personen, organisaties, rollen, rangen, functies, plaatsen, datums, gebeurtenissen, schuilnamen, dossiers, identifiers, onderscheidingen, voorwerpen, werken (boeken, documentaires), bedragen of hoeveelheden, en de relaties tussen al deze elementen.